虚拟现实设备体会的提高除了与处理器、显现技能等休戚相关,与虚拟现实设备的交互也十分重要。不管在VR仍是AR设备中,语音、体感、手势辨认都或许成为提高体会的交互方法。本文将介绍干流的光学手势辨认技能。

谈起手势辨认技能,由简略大略的到杂乱精密的,大致能够分为三个等级:二维手型辨认、二维手势辨认、三维手势辨认。

在详细评论手势辨认之前,咱们有必要先知道二维和三维的不同。二维仅仅一个平面空间,咱们能够用(X坐标,Y坐标)组成的坐标信息来表明一个物体在二维空间中的坐标方位,就像是一幅画出现在一面墙上的方位。三维则在此根底上增加了“深度”(Z坐标)的信息,这是二维所不包括的。这儿的“深度”并不是咱们现实生活中所说的那个深度,这个“深度”表达的是“纵深”,了解为相关于眼睛的“远度”或许愈加恰当。就像是鱼缸中的金鱼,它能够在你面前上下左右的游动,也或许离你更远或许更近。

前两种手势辨认技能,彻底是依据二维层面的,它们只需求不含深度信息的二维信息作为输入即可。就像平常摄影所得的相片就包括了二维信息相同,咱们只需求运用单个摄像头捕捉到的二维图画作为输入,然后经过核算机视觉技能对输入的二维图画进行剖析,获取信息,然后完成手势辨认。

而第三种手势辨认技能,是依据三维层面的。三维手势辨认与二维手势辨认的最底子差异就在于,三维手势辨认需求的输入是包括有深度的信息,这就使得三维手势辨认在硬件和软件两方面都比二维手势辨认要杂乱得多。关于一般的简略操作,比方仅仅想在播映视频的时分暂停或许继续播映,二维手势也就足够了。可是关于一些杂乱的人机交互,与3D场景互动,就必须含有深度信息才行。

二维手型辨认

二维手型辨认,也可称为静态二维手势辨认,辨认的是手势中最简略的一类。这种技能在获取二维信息输入之后,能够辨认几个静态的手势,比方握拳或许五指打开。其代表公司是一年前被Google收买的Flutter。在运用了他家的软件之后,用户能够用几个手型来操控播映器。用户将手掌举起来放到摄像头前,视频就开端播映了;再把手掌放到摄像头前,视频又暂停了。

“静态”是这种二维手势辨认技能的重要特征,这种技能只能辨认手势的“状况”,而不能感知手势的“继续改变”。举个比方来说,假如将这种技能用在猜拳上的话,它能够辨认出石头、剪刀和布的手势状况。可是对除此之外的手势,它就一无所知了。所以这种技能说到底是一种形式匹配技能,经过核算机视觉算法剖析图画,和预设的图画形式进行比对,然后了解这种手势的意义。

这种技能的不足之处清楚明了:只能够辨认预设好的状况,拓宽性差,操控感很弱,用户只能完成最根底的人机交互功用。可是它是辨认杂乱手势的第一步,并且咱们确实能够经过手势和核算机互动了,仍是很帅的不是么?幻想一下你忙着吃饭,只需随便做个手势,核算机就能够切换到下一个视频,比运用鼠标来操控可是便利多了!

二维手势辨认

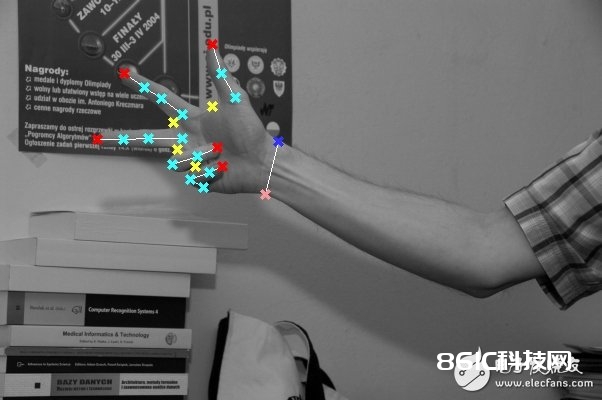

二维手势辨认,比起二维手型辨认来说稍难一些,但仍然根本不含深度信息,停留在二维的层面上。这种技能不只能够辨认手型,还能够辨认一些简略的二维手势动作,比方对着摄像头挥挥手。其代表公司是来自以色列的PointGrab,EyeSight和ExtremeReality。

二维手势辨认具有了动态的特征,能够追寻手势的运动,然后辨认将手势和手部运动结合在一起的杂乱动作。这样一来,咱们就把手势辨认的规模真实拓宽到二维平面了。咱们不只能够经过手势来操控核算机播映/暂停,咱们还能够完成行进/撤退/向上翻页/向下翻滚这些需求二维坐标改变信息的杂乱操作了。

这种技能虽然在硬件要求上和二维手型辨认并无差异,可是得益于愈加先进的核算机视觉算法,能够取得愈加丰厚的人机交互内容。在运用体会上也提高了一个层次,从朴实的状况操控,变成了比较丰厚的平面操控。这种技能现已被集成到了电视里,可是还没有成为常用操控方法。

三维手势辨认

接下来咱们要谈的便是当今手势辨认范畴的重头戏——三维手势辨认。三维手势辨认需求的输入是包括有深度的信息,能够辨认各种手型、手势和动作。比较于前两种二维手势辨认技能,三维手势辨认不能再只运用单个一般摄像头,由于单个一般摄像头无法供给深度信息。要得到深度信息需求特别的硬件,现在国际上主要有3种硬件完成方法。加上新的先进的核算机视觉软件算法就能够完成三维手势辨认了。下面就让小编为咱们一一道来三维手势辨认的三维成像硬件原理。

1. 结构光(Structure Light)

结构光的代表运用产品便是PrimeSense的Kinect一代了。

这种技能的根本原理是,加载一个激光投射器,在激光投射器外面放一个刻有特定图样的光栅,激光经过光栅进行投射成像时会发生折射,然后使得激光终究在物体外表上的落点发生位移。当物体间隔激光投射器比较近的时分,折射而发生的位移就较小;当物体间隔较远时,折射而发生的位移也就会相应的变大。这时运用一个摄像头来检测收集投射到物体外表上的图样,经过图样的位移改变,就能用算法核算出物体的方位和深度信息,然后恢复整个三维空间。

以Kinect一代的结构光技能来说,由于依赖于激光折射后发生的落点位移,所以在太近的间隔上,折射导致的位移尚不显着,运用该技能就不能太准确的核算出深度信息,所以1米到4米是其最佳运用规模。

2. 光飞时刻(TIme of Flight)

光飞时刻是SoftKineTIc公司所选用的技能,该公司为Intel供给带手势辨认功用的三维摄像头。一起,这一硬件技能也是微软新一代Kinect所运用的。

这种技能的根本原理是加载一个发光元件,发光元件宣布的光子在碰到物体外表后会反射回来。运用一个特别的CMOS传感器来捕捉这些由发光元件宣布、又从物体外表反射回来的光子,就能得到光子的飞翔时刻。依据光子飞翔时刻然后能够推算出光子飞翔的间隔,也就得到了物体的深度信息。

就核算上而言,光飞时刻是三维手势辨认中最简略的,不需求任何核算机视觉方面的核算。

3. 多角成像(MulTI-camera)

多角成像这一技能的代表产品是Leap MoTIon公司的同名产品和Usens公司的Fingo。

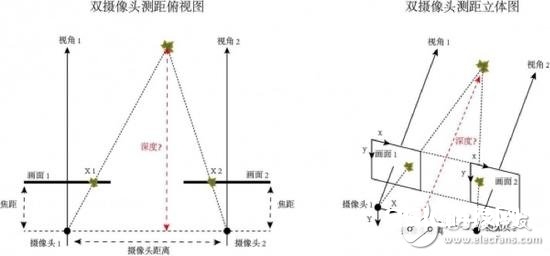

这种技能的根本原理是运用两个或许两个以上的摄像头一起吸取图画,就好像是人类用双眼、昆虫用多目复眼来调查国际,经过比对这些不同摄像头在同一时刻取得的图画的不同,运用算法来核算深度信息,然后多角三维成像。

在这儿咱们以两个摄像头成像来简略解释一下:

双摄像头测距是依据几许原理来核算深度信息的。运用两台摄像机对当时环境进行拍照,得到两幅针对同一环境的不同视角相片,实际上便是模拟了人眼作业的原理。由于两台摄像机的各项参数以及它们之间相对方位的联系是已知的,只需找出相同物体(枫叶)在不同画面中的方位,咱们就能经过算法核算出这个物体(枫叶)间隔摄像头的深度了。

多角成像是三维手势辨认技能中硬件要求最低,但一起是最难完成的。多角成像不需求任何额定的特别设备,彻底依赖于核算机视觉算法来匹配两张图片里的相同方针。比较于结构光或许光飞时刻这两种技能本钱高、功耗大的缺陷,多角成像能供给“价廉物美”的三维手势辨认作用。

本文参阅王元的《运用于VR/AR的干流光学手势辨认技能解析》文章