前语

机器学习技能为现代社会的许多范畴供给了强壮的技能支持:从网络查找到交际网络的内容过滤,再到电子商务网站的产品引荐。机器学习技能正越来越多的呈现在消费级产品上,比方照相机和智能手机。 机器学习体系可用于辨认图画中的方针,将语音转换成文本,挑选查找效果的相关项,以及匹配新闻、帖子或用户感兴趣的其他东西。 相似的运用越来越多,它们都运用了一种叫做深度学习的技能。

深度学习(也称为深层结构学习、层次学习或深度机器学习)是根据对数据中的高档笼统进行建模的算法,它归于机器学习的分支。最简略的比方,你可以有两组神经元:接纳输入信号的神经元和发送输出信号的神经元。当输入层接纳到输入时,它将输入的修正版别传递给下一层。在深层网络中,输入和输出层之间有许多层(层并不是由神经元构成,这儿仅仅为了协助你考虑),这些层答应算法运用多个处理层,这些层包含了多个线性和非线性改换。

近来,深度学习技能使得机器学习发生了革命性的改变,并呈现了许多巨大的效果。 它们大大改进了语音辨认、视觉方针辨认、方针检测以及许多其他范畴(如药物发现和基因组学)的技能。 “深度学习”这个术语最早由Dechter(1986)引进机器学习,由Aizenberg等人(2000)引进人工神经网络(NN)。 深度学习的进一步遍及得益于由Alex Krizhevsky创造的被称为“AlexNet”的卷积网络架构的呈现。“AlexNet”在2012年的ImageNet竞赛中打败了其他一切的图画处理算法,创始了在图画处理中运用深度学习架构的先河。

深度学习架构

1. 生成式深度架构,旨在描绘用于方式剖析或组成意图的观测数据或可见数据的高阶相关特性,以及描绘可见数据及其相关类的联合核算散布的特征。在后一种情况下,运用贝叶斯规矩可以将这品种型的架构变成区分式深度架构。

2. 区分式深度架构,旨在直接供给方式分类的区分力,一般经过描绘根据可见数据品种的后验散布来描绘。

3. 混合式深度架构,其意图是区分,但一般辅以经过更好的优化或规矩化的生成架构的效果,或者是其区分规范被用来学习类别1中的任何一个深度生成模型的参数

虽然深度学习架构的分类很杂乱,但在实践中常常用到的有深度前馈网络、卷积网络和循环网络。

深度前馈网络

前馈网络,一般被称为前馈神经网络或多层感知器(MLP),它是典型的深度学习方式。

前馈网络的方针是迫临某个函数f。例如,关于一个分类器,y=f(x)表明的是将输入x映射到类别y。前馈网络界说了一个映射 y=f(x;θ),并学习能发生最佳迫临函数的参数θ的值。

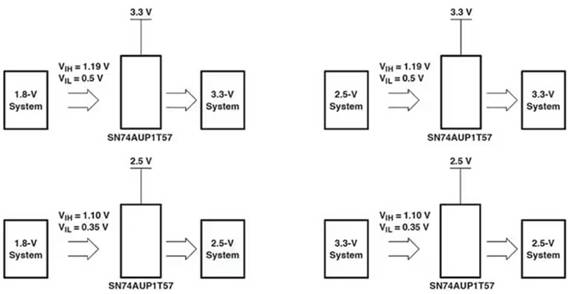

简略来说,网络可以界说为输入、躲藏和输出节点的组合。数据从输入节点流入,在躲藏节点中进行处理,然后经过输出节点发生输出。信息流经从x评价的函数,经过用于界说f的中心核算,最后到输出y。该网络中没有反响衔接,其间模型的输出反响到本身,因而模型被称为前馈网络。该模型如图[1]所示。

图[1]:前馈神经网络

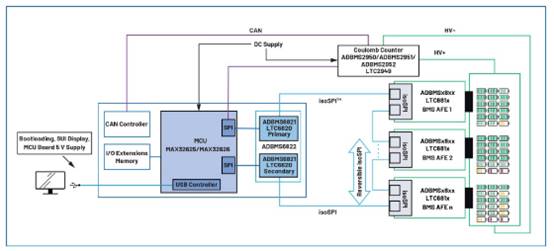

卷积神经网络

在机器学习中,卷积神经网络(CNN或ConvNet)是一种前馈人工神经网络,其神经元之间的衔接方式是受动物视觉皮层安排的启示而创造出来的。

单个皮质神经元对受限区域的影响呼应称为感触野。不同神经元的感触野部分堆叠,这使得这些感触野像瓦片相同平铺。

单个神经元对其感触野内的影响的反响可以用卷积运算近似地数学化。卷积网络的创意来自于生物学,是多层感知器的变体。它在图画和视频辨认、引荐体系和自然言语处理中具有广泛的运用。

LeNet是第一个卷积神经网络,它推动了深度学习范畴的开展。自1988年以来,Yann LeCun的这项创始性作业屡次成功迭代后成为了LeNet5。其时的LeNet架构首要用于字符辨认,如阅览邮政编码、数字等等。

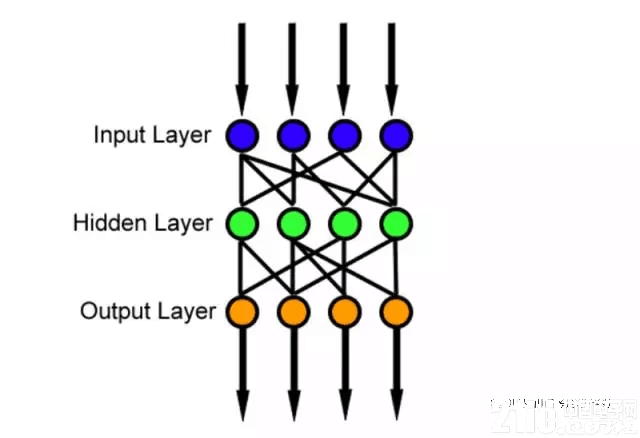

图[2]:一个简略的卷积神经网络模型

ConvNet有四个首要组件,如图2所示:

1.卷积层

2.激活函数

3.池化层

4.彻底衔接层

卷积层

卷积层根据术语“卷积”,它是对两个变量履行数学运算(f*g),以发生第三个变量。 它与互相关相似。 卷积层的输入是一幅 m x m x r 的图画,其间m是图画的高度和宽度,r是通道数,例如,关于RGB图画,r = 3 。 卷积层有巨细为n x n x q的k个过滤器(或内核),其间n小于图画的维度,并且q小于等于通道数r,并且每个内核都可以不同。

激活函数

要完成杂乱的映射函数,需求有非线性的激活函数,这样引进十分重要的非线性特点,使之可以近似于任何函数。激活函数关于紧缩来自神经元的无界线性加权和也是十分重要的。这关于防止在处理层次上堆集高值十分重要。有许多常常被用到的激活函数,比方Sigmoid、tanh和ReLU。

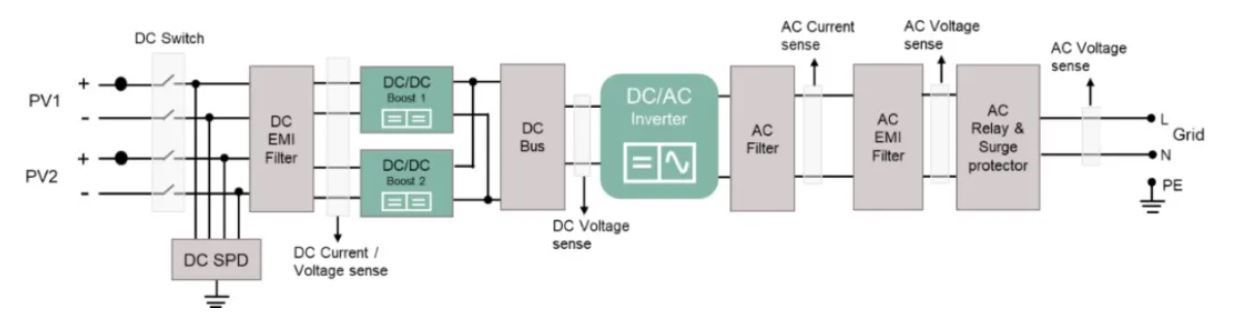

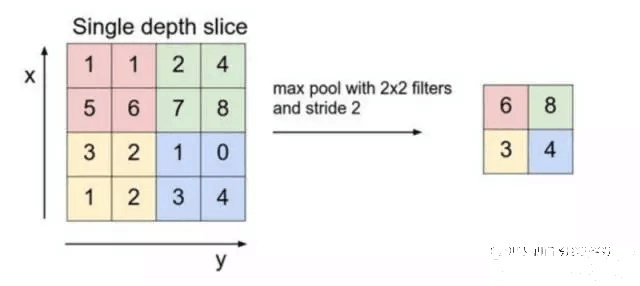

池化层

池化是一个根据样本的离散化进程。它的方针是对输入表明(图画、躲藏层输出矩阵等等)进行降采样,削减其维度,并答应对包含在子区域中的特征进行假定。

这样做的部分原因是为了供给一种笼统的表明方式来防止过度拟合。相同,它经过削减要学习的参数个数来下降核算成本,并为内部表明供给根本的转化恒定性。

比较突出的池化技能有:最大池化,最小池化和均匀池化。

图[3]:2*2过滤器的最大池化示例

彻底衔接层

术语“彻底衔接”意味着上一层中的每个神经元都衔接到下一层的每个神经元。彻底衔接层是传统的多层感知器,它运用softmax激活函数或输出层中的任何其他相似函数。

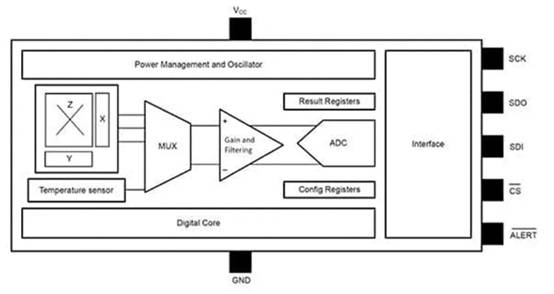

循环神经网络

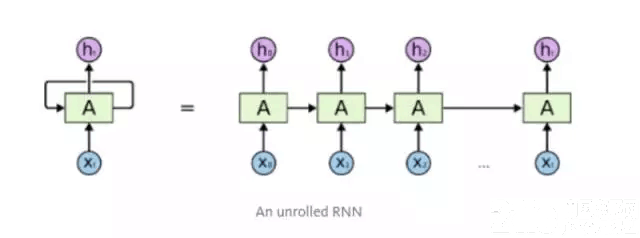

在传统的神经网络中,咱们假定一切的输入(和输出)是彼此独立的。可是关于许多的使命来说,这是一个很糟糕的假定。假如你想猜测一个语句中的下一个单词,你最好知道哪些前面的单词是什么。 RNN之所以称为循环,由于它们对序列的每个元素履行相同的使命,而输出依靠于从前的核算。还有一种了解RNN的办法,咱们可以以为它有“回忆”的,它会捕获到到现在核算出来的一切信息。

RNN中有循环,这使得在读入输入时可以跨神经元传递信息。在图[4]中,x_t是某种输入,A是RNN的一部分,h_t是输出。RNN有一些特别的类型,比方LSTM、双向RNN,GRU等等。

图[4]:RNN模型

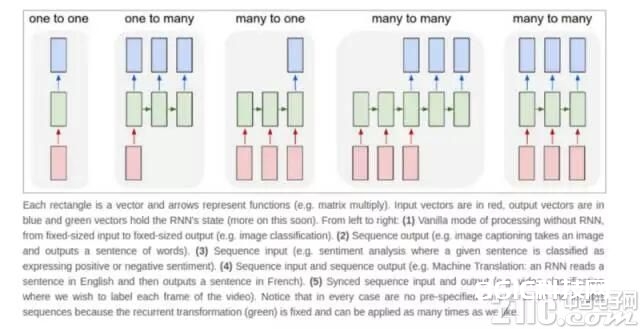

RNN可用于NLP、机器翻译、言语建模、核算机视觉、视频剖析、图画生成、图画字幕等,这是由于在RNN中可以放置恣意数量的输入和输出,并让它们一一对应、多对多对应。它架构存在多种方式,如图[5]所示。

图[5]:RNN描绘了对矢量序列的操作

运用

在深度学习范畴现已有了许多的研讨,并且有许多特别的问题都运用深度学习模型得到了处理。这儿有一些深度学习方面的优异运用:

是非图画五颜六色化

深度学习可用于参照照片中的方针及其上下文来对图画进行上色,就像人类进行上色相同。这个运用需运用十分大的卷积神经网络和监督层,经过增加色彩来重现图画。

机器翻译

文本翻译可以在没有对序列进行任何预处理的情况下进行,它答应算法学习单词之间的依靠联系及其与另一种言语之间的映射。大型LSTM循环神经网络的堆叠网络可用于机器翻译。

照片中物体的分类及检测

该使命是将照片中的方针归类到已知的方针组中去。在样例评测中,经过运用十分大的卷积神经网络可以获得十分好的效果。 Alex Krizhevsky等人在ImageNet分类中获得的突破性效果,被称为AlexNet。

主动手写生成

给定一个手写示例语料库,然后为给定的单词或短语生成新的笔迹。在笔迹样本被创立时,笔迹将作为一系列的坐标供给给笔。经过这个语料库,算法会学习笔的运动与字母之间的联系,然后生成新的示例。

主动打游戏

在这个运用中,模型将学习怎么仅根据屏幕上的像素点来玩电脑游戏。这在深度增强模型范畴中是一个十分难的使命,由于这个,DeepMind(现在是Google的一部分)赢得了很高的名誉。

生成模型谈天机器人

运用根据序列的模型来创立谈天机器人,该机器人在许多实在的对话数据集上进行练习,并学会生成自己的答案。要了解更多的详细信息,请拜访这个链接。

总结

从本文可以得到这样的定论:深度学习模型可以用于各种使命,由于它可以模仿人脑。截止现在,专家们现已在这方面做了很多的研讨,并且在不久将还有许多研讨作业要做。虽然现在还存在信赖问题,但在不久的将来,这个问题将会变得愈加明亮。