你是否注意到,当拍照水下相片的时分图画会呈现比以往拍照作用更严峻的含糊而且失真的状况?这是由于光衰减和反向散射等现象会对可见度发生晦气影响。

为了处理这个问题,我国哈尔滨工程大学的研讨人员规划了一种机器学习算法,该算法可以生成传神的水下图画;另一种算法,则可以对这些图画进行深度练习,以到达康复天然色彩并削减雾度的作用。他们说,这种办法在质量和数量上都与最新技能相匹配,而且可以在单个显卡上以每秒 125 帧的速度进行处理。

该团队指出,大多数水下图画增强算法(例如那些调整白平衡的算法)都不是根据物理成像模型完成,这使其不适用于一些使命。相比之下,这种办法使用了生成式对立网络( GAN )(一种深度学习模型,模型经过结构中两个模块:生成模型和判别模型的相互博弈学习发生相当好的输出),以生成一组特定查询地址的图画并在此基础上引进第二种算法, U-Net 。

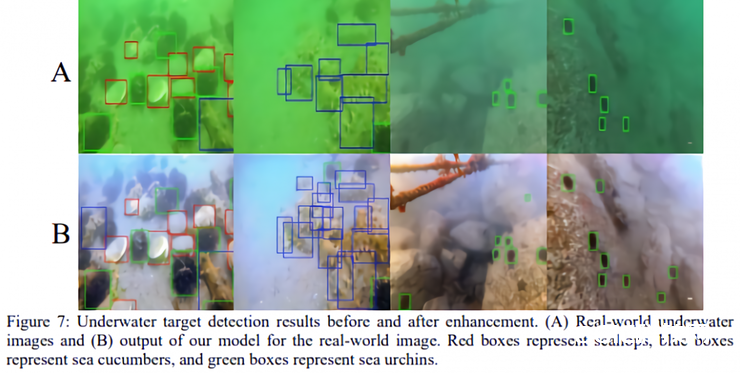

研讨小组对 GAN 进行了一系列有符号场景的练习,这些场景包含 3733 幅图画和相应的深度地图,首要包含扇贝、海参、海胆和室内海洋农场内的其他此类生物。他们还获得了包含 NY Depth 在内的揭露数据集,其间包含了一共数千张水下相片。

练习后,研讨人员将双模型办法的成果与基线模型办法的成果进行了比较。他们指出,前者技能的优势在于它在色彩康复上是一致的,这使它能在很好康复绿色色彩图画的一起,不损坏原始输入图画的底层结构。通常状况下,这种方法在坚持“恰当的”亮度和对比度的一起,还能设法康复色彩,而在这方面其他处理方案并不特别拿手。

值得注意的是,这并不是第一个想到使用AI技能从损坏的图片中重建画面的研讨团队。剑桥咨询( Cambridge Consultants )公司的 AI 体系 DeepRay 使用了一套练习有素的 GAN 来处理 10 万张静止图画的数据集,以消除不透明的玻璃窗格导致的失真。开源 DeOldify 项目使用了包含 GANs 在内的一系列人工智能模型来对旧图画和胶片进行上色和康复。

在其他方面,微软亚洲研讨院( Microsoft Research Asia )的科学家在 9 月份具体介绍了一个用于自主视频上色的端到端体系; NVIDIA 的研讨人员上一年描绘了一个结构,该结构仅根据一个被注释过得五颜六色视频帧揣度色彩分类;本年 6 月,谷歌AI团队推出了一种无需人工监督即可对灰度视频进行上色的算法。

venturebeat

本文转自雷锋网,如需转载请至雷锋网官网请求授权。

原文章地址为研讨人员共享怎么使用 AI 技能处理水下图片含糊和上色问题